NVIDIA GTC 2026が明確にした点: AIの次の飛躍はストレージにかかっている

今年3月にカリフォルニア州サンノゼで開催されたNVIDIA GTC 2026において、共通するテーマが1つあるとすれば、それはより大きなモデルや派手なデモではありませんでした。それは次の点です。

AIの進歩は、もはやコンピュートだけによって制約されるものではありません。むしろ、データを移動・保存する速度と効率にますます左右されるようになっています。

新しいAIシステムを構築する場合でも、既存のシステムを拡張する場合でも、重要となる5つのポイントがあります。

1. GPUの性能は、データパイプライン次第

私たちはすでに、数万ドルもするアクセラレーターがアイドル状態のまま放置される時代に正式に突入しています。

NVIDIAのような企業が提供する最新のGPUは、大規模な並列処理を前提に設計されています。しかし、それらが真価を発揮するのは、高スループットかつ低レイテンシーのデータストリームが継続的に供給されている場合に限られます。

データ不足に陥ったアクセラレーターは、単に非効率なだけでなく、コストのかかる状態でもあります。ここで重要になるのが、ストレージアーキテクチャです。

- 高性能なNVMe階層

- 並列ファイルシステム

- データローカリティ戦略

NVIDIAによれば、GPUの性能を最大限に引き出すには、システム全体のエンドツーエンドのバランスが極めて重要です。1実際には、これはストレージがもはや後付けの要素ではなく、コンピューティング戦略の不可欠な構成要素になっていることを意味しています。

2. AIは急速に進化しているが、データはそれ以上のスピードで増大している

AIアプリケーションの進化は、段階的な波として進んできました。

- 2024年: チャットボット

- 2025年: コパイロット

- 2026年: 自律型エージェント

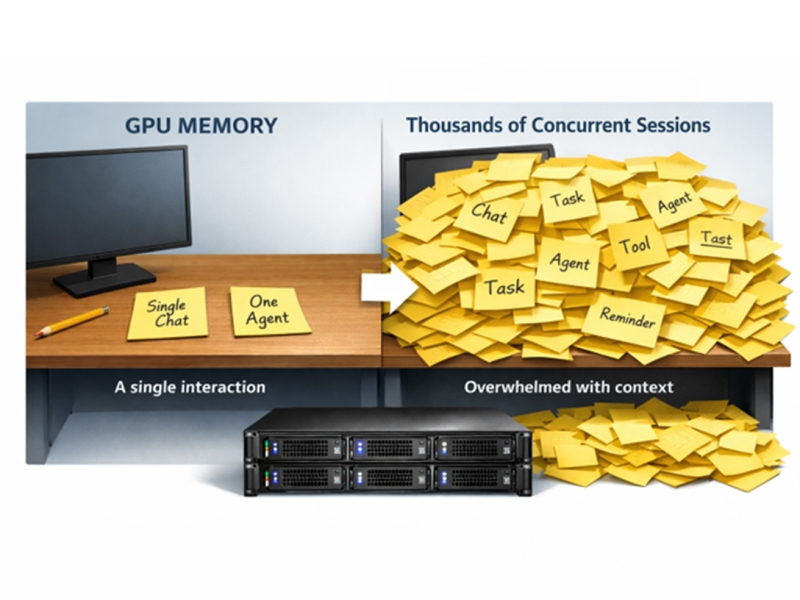

スタックが一段階進むごとに、価値が高まるだけでなく、必要となるデータ量も大幅に増加します。

エージェントは単に応答するだけではありません。計画を立て、反復処理を行い、ツールを呼び出し、高度なアウトプットを生成します。つまり、1回のユーザーインタラクションが、数十回、場合によっては数百回のモデル処理へと膨れ上がる可能性があるということです

Gartnerのような調査会社による業界調査でも、エージェントベースのシステムが今後10年間で企業におけるAI導入の主流になることが指摘されています。そして、こうしたシステムは本質的により多くのデータを必要とします。 2

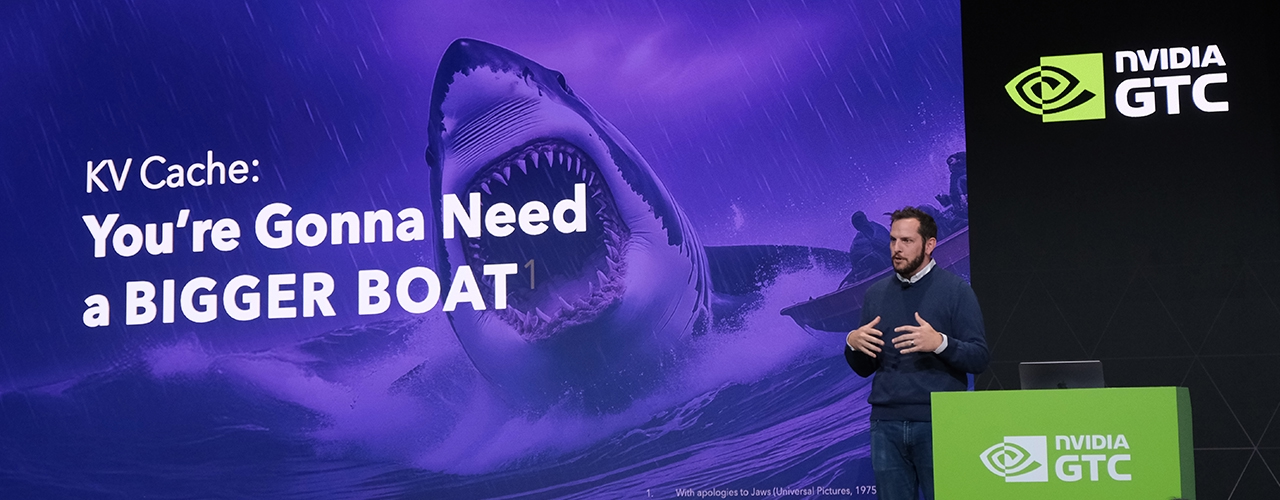

3. 推論が新たなデータ津波になりつつある

かつては、インフラに関する議論の中心はトレーニングでした。もはや事情は異なります。現在は推論がスケール拡大の主要な要因となっており、その負荷もますます大きくなっています。

- より大きなコンテキストウィンドウ。 詳しくは次の記事をご覧ください: 推論コンテキスト・メモリ・ストレージ(ICMS):AI推論がフラッシュでしか解決できない問題になりつつある理由

- 検索拡張生成(RAG)。 詳しくは次の記事をご覧ください: SSDオフロード技術によるAIスケールの実現

- マルチステップのエージェントワークフロー。

1つのプロンプトは、もはや単なる1回のプロンプトにとどまりません。そこから分岐していきます。そして、そのすべての処理には、大規模なワーキングデータセットへ高速にアクセスできる能力が必要です。DRAMだけでは対応できません。コストが高すぎるうえ、容量にも限界があります。そのため現在、階層型メモリアーキテクチャへの移行が進んでいます。これは、高性能SSDによって実効的なメモリ容量を拡張する仕組みです。

NVIDIAのような企業は、特にモデルが外部データへの依存を強めるにつれて、スケーラブルな推論を可能にする上でのストレージの役割を強調しています。

4. 実際に重要な指標は「ワット当たりのトークン数」

AIの成功を測る指標には、静かな変化が起きています。もはや単に「1秒当たりのトークン数」だけではありません。

なぜでしょうか? なぜなら、電力は厳しい制約条件だからです。大規模なAIシステムの運用は、ハードウェアだけでなく、エネルギーの面でも高コストです。非効率なシステムは経済的に拡張できません。そして効率の向上は、必ずしも新しいチップによって実現されるわけではありません。ストレージの高密度化、アイドル状態のコンピューティング・サイクルの最小化、そしてデータ移動量の最小化が本質的な鍵になります。

NVIDIA GTC 2026のインフラ関連の議論でも強調されていたように、効率性はもはやシリコンだけの問題ではなく、システム全体の課題になっています。

5. AIは集中型と分散型の両方で展開される:それを支えるのがストレージ

AIアーキテクチャの議論では、集中型かエッジかという二者択一のように語られることがあります。しかし実際には、その両方が必要になるケースが多いのが現実です。

中央集約型のAIファクトリーは、モデル学習、大規模推論、そしてデータ集約を担います。一方で、エッジ環境へのデプロイは、リアルタイムな意思決定、レイテンシに敏感なワークロード、高いデータ主権要件を持つアプリケーションにおいて重要な役割を果たします。

その両者をつなぐものは何でしょうか?それがストレージです。

AIファクトリーとエッジデプロイメントのいずれにおいても、高いスループット、容量、そしてスケーラビリティが求められます。ストレージ性能と記録密度における継続的なブレークスルーがなければ、どちらもその潜在能力を十分に引き出すことはできません。

終わりに

AIイノベーションは、制約となる要因が変化する中で加速しています。2026年において、その制約はコンピュートではありません。モデルでもありません。それはデータインフラです。

そこで重要になるのが、Solidigmです。Solidigmは、性能、効率、そしてスケールを実現するために設計された業界トップクラスの大容量ストレージによって、次世代AIを支えています。結局のところ、AIの未来はどれだけ速く思考できるかだけで決まるものではありません。どれだけ速くマシンにデータを供給できるかにかかっています。

著者について

Ace Stryker(エース・ストライカー)は、SolidigmのAI & エコシステムマーケティング担当ディレクターであり、データセンターストレージソリューションのポートフォリオの新たな分野の開発に力を注いでいます。

参考資料